Файл robots.txt играет важную роль в облегчении работы поискового бота. Нужно дружить с поисковым ботом, так как именно благодаря его посещениям на ваш сайт, поисковые системы узнают о важных страницах, ключевых фразах и релевантности.

Именно благодаря «приходу в гости» поискового робота на Ваш проект, сайт наконец может начать хорошо ранжироваться в поисковой выдаче. Поэтому сделайте это посещение приятным для поискового бота и начните с robots.txt! Я расскажу как это сделать лучше всего!

Содержание публикации:

Почему так важен robots.txt?

Robots.txt это путеводная карточка для поискового бота. Благодаря директивам (командам) robots.txt Вы даете подробную информацию краулеру о том в какие места сайта Вы приглашаете его, а в какие предостерегаете от посещений.

Это удобно и Вам и поисковой системе. Важно использовать robots.txt по назначению. Существует несколько важных правил, которые необходимо соблюдать. В первую очередь язык конфигураций для robots.txt един для всех проектов и всех поисковых систем.

Во-вторых, важно обязательно указать для какого именно бота будут даны команды (у всех ботов один «язык» на котором они усваивают команды. Но разные предпочтения и взгляды на то, какие «места» Вашего сайта они хотели бы посещать).

Также в файле robots.txt всегда указываются директивы sitemap, которая дает путь к общей карте сайта, и host (которая дает адрес на главное зеркало сайта, чтобы бот не блуждал по возможной копии Вашего проекта – не главному зеркалу).

Ошибки robots.txt, которые мне встречались на практике

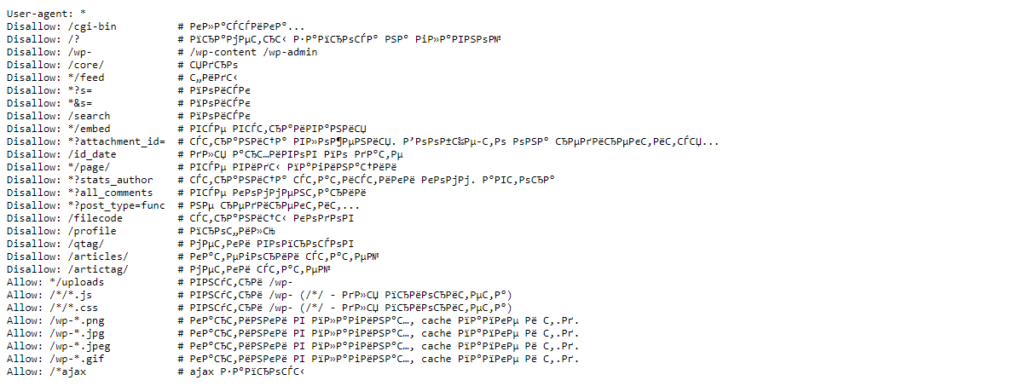

Не допускайте использование некорректной кодировки в Вашем файле robots.txt. Однажды я встретил вот такой robots.txt:

Не замусоривайте файл лишними конфигурациями. Нравится ли Вам читать огромные инструкции? Аналогично и боты могут невзлюбить проект со слишком большим количеством лишних инструкций. Бот может просто отказаться от директив и пойти своим путем (на практике это действительно часто происходит).

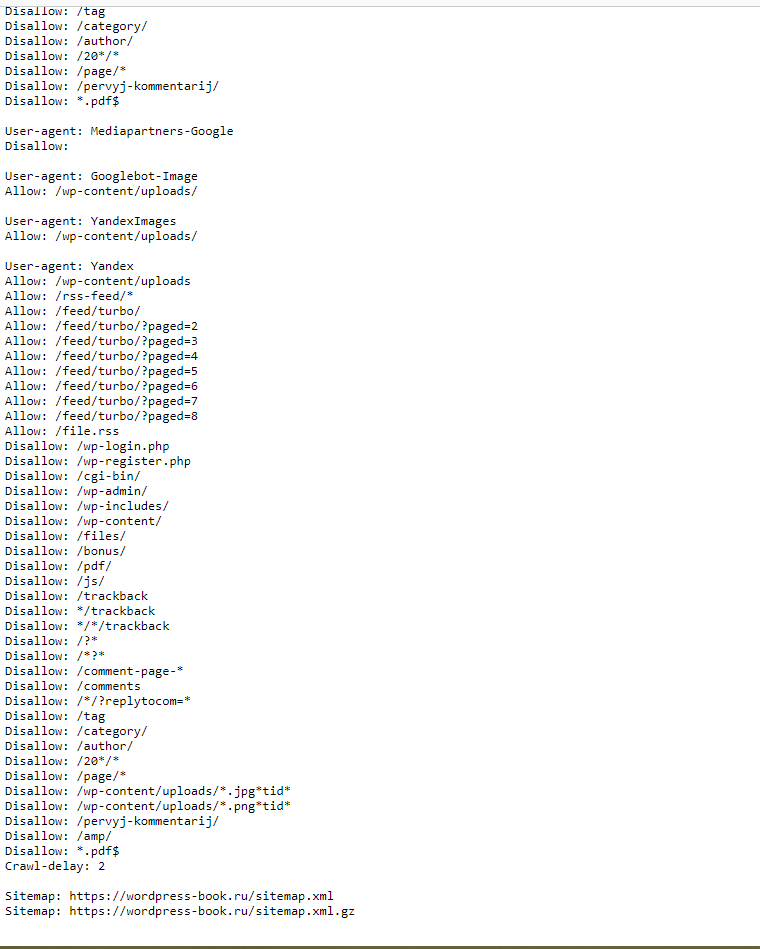

Взгляните на такие примеры robots.txt и никогда так не делайте:

Пример самого длинного robots.txt, которое мне доводилось видеть содержит 293 строчки и принадлежит сайту Forbes: https://www.forbes.com/robots.txt

Запомните, что так делать не стоит! Forbes имеет далеко не самую лучшую видимость и выигрывает за счет известности бренда и поведенческих факторов.

Где находится Robots.txt у WordPress?

Данный файл располагается в корневом каталоге сайта. Это неизменное правило для всех проектов, так как является стандартом W3C.

При использовании браузера robots.txt можно обнаружить по следующему пути:

Такое расположение будет правильным для любого проекта и именно его нужно использовать.

Примеры элегантных robots.txt для WordPress

Я люблю математику и поэтому мне нравится делать сравнения из математического мира. Robots.txt должны быть как лучшие уравнения в математике, которые принято называть элегантными. Одно из самых известных и популярных уравнений это E=mc2. Здесь нет ничего лишнего. Посмотрите на примеры лучших robots.txt с очень авторитетных ресурсов (многие из них написаны разработчиками WP).

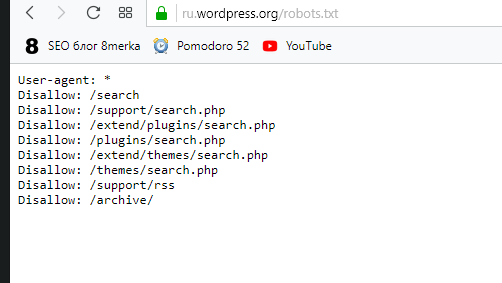

Пример robots.txt с официального сайта WordPress, очень короткое и емкое содержание – ничего лишнего.

Правильный Robots txt для WordPress 2018

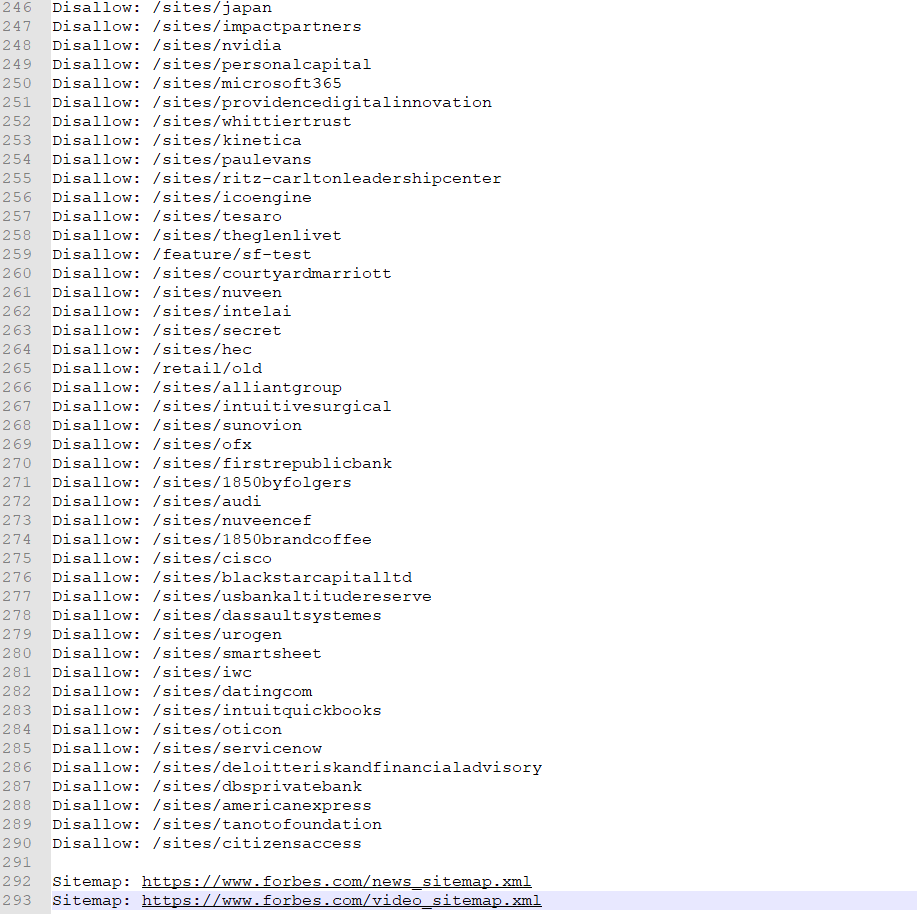

Для каждого сайта будет свой уникальный robots.txt, однако наиболее близкий по точности общий пример robots txt для wordpress на 2018 год будет выглядеть так:

User-agent: *

Disallow: /cgi-bin

Disallow: */embed*

Disallow: */wp-json*

Disallow: */?ild=*

Disallow: /wp-admin

Disallow: /wp-includes

Host: https://8merka.ru

Sitemap: https://8merka.ru/sitemap.xml

Что означают директивы правильного robots.txt для WordPress в 2018 году?

User-agent: * — это указание того, что все команды предназначены для всех ботов.

При необходимости можно указывать команды для Яндекса благодаря следующей директиве: User-agent: Yandex

Аналогично для Google: User-agent: Googlebot

Disallow: /cgi-bin – запрещает переход в каталог, который предназначен для некоторых серверных скриптов. Эти страницы не представляю особой ценности для бота, поэтому не будем злоупотреблять данной нам квотой на индексацию.

Disallow: */embed* — закрывает от индексации встраивания, которые порой являются проблемой для WordPress.

Disallow: */wp-json*- закрываем виртуальную директорию API REST для WordPress.

Disallow: /wp-admin – закрываем доступ в админ-панель сайта.

Disallow: /wp-includes – здесь располагается вся техническая часть WordPress. Боту ни к чему ковыряться в механизмах работы сайта, так как они в любом случае для всех сайтов WordPress одинаковы.

Host: https://8merka.ru – указываем главное зеркало сайта

Sitemap: https://8merka.ru/sitemap.xml — облегчаем работу поискового бота и указываем корректное расположение карты сайта.

Лучшие плагины Robots.txt для WordPress

Для работы с Вашим robots.txt в front-end режиме можно использовать плагин: https://ru.wordpress.org/plugins/pc-robotstxt/

Такой плагин не дает каких-либо дополнительных функций, но удобен для тех, кто не хотел бы совершать лишние действия по переходу на SSH или FTP.

Аналогично с данной функцией справляется знаменитый плагин YOAST SEO. разработанный американскими коллегами, о котором я ранее делал большой обзорный пост. Рекомендую почитать этот пост и внимательно ознакомиться, так как плагин имеет и ряд других полезных функций.

Как добавить Robots.txt на сайт WordPress?

Добавить robots.txt на свой сайт можно благодаря переходу на SSH или FTP Вашего сайта. Воспользуйтесь подготовленной мной формой: шаблон_robots.txt_2018

Поправьте директивы sitemap и host под свои сайты и загрузите данный файл в корневой каталог Вашего сайта.

Также можно использовать плагины о которых я говорил ранее: Virtual Robots.txt или YOAST SEO.

Если у Вас проблемы с robots.txt Вы всегда можете обратиться ко мне. Чаще всего я бесплатно помогаю разобраться с этим файлом, так как мне всегда интересно поковыряться в настройках конфигураций, поэтому буду рад помочь.

Все по делу. Спасибо.

seoonly.ruЦитировать

Добрый вечер! Николай, классная статья про robots. Есть вопросик. Что мне делать если я хочу, чтобы у меня быстрее проиндексировался конкретный раздел сайта — есть идеи?

maximus_seosЦитировать

Здравствуйте! Есть один интересный способ. Можно почистить robots.txt. Добавить туда директиву allow на Ваш раздел (других директив добавлять не нужно). Затем проделать аналогичную процедуру с sitemap.xml (внести в sitemap главную страницу, страницу раздела и все прилежащие к разделу страницы). Скормить поисковым системам robots.txt и sitemap.xml в панелях для вебмастеров. После индексации вернуть обычные robots.txt и sitemap.xml.

Это достаточно жесткий и действенный метод, поэтому использовать нужно с осторожностью и пониманием того, что Вы играете с крауллинговым бюджетом. Материалы раздела должны быть качественными!

Климович НиколайЦитировать

Очень круто! Спасибо! Николай, а Вы можете у нас эту процедуру провести?

maximus_seosЦитировать

Работаю с проектами только на постоянной основе. Если Вам интересно, напишите адрес сайта на ceo@8merka.ru

Климович НиколайЦитировать

Николай, я Вам на почту прислал адрес сайта.

maximus_seosЦитировать

Добрый день! Вот мне всегда нравятся ваши статьи. Жду их с нетерпением каждый раз. Пишите очень увлекательно!

АлексейЦитировать

Николай, спасибо за статью! Обязательно ли нужно указывать host в robots.txt? Например, у нас на сайте нет такой строчки — значит ли, что у нас не правильный robots.txt?

АлександраЦитировать

Очень желательно, так как при возникновении проблем с главным зеркалом сайта могут быть неприятности с индексацией или ранжированием сайта. Да и валидатор Яндекса будет ругаться. )

Климович НиколайЦитировать

Николай, спасибо большое! Будем делать 🙂

АлександраЦитировать

Добрый день! Если на сайте нет robots.txt , а он уже проиндексировался, то нужно ли добавлять его на сайт или нет? И не совсем понимаю как сайт проиндексировался, если на нем нет robots.txt.

AnnaЦитировать

Сайт может быть проиндексирован независимо от того имеется ли на нем robots.txt или нет, но качество индексации напрямую зависит от директив robots.txt. Почти уверен, что найду на Вашем проекте большое количество «мусорных» страниц, которые съедают крауллинговый бюджет. Поэтому нужно срочно делать правильный robots.txt

Климович НиколайЦитировать

А Вы можете посмотреть наш проект — насколько у нас все плохо вообще с этим?

AnnaЦитировать

Могу! Пришлите сюда адрес сайта или на почту ceo@8merka.ru

Климович НиколайЦитировать

Супер!

ЖеняЦитировать

Супер )

Климович НиколайЦитировать

Респект за демонстрацию интересных примеров robots.txt!

Миша МЦитировать

Спасибо, старался. )

Климович НиколайЦитировать

Большое спасибо! Взял шаблон для своего сайта )

lidЦитировать

Рад, что пригодилось. )

Климович НиколайЦитировать

Отличный блок про robots.txt. Казалось бы об этом уже все что можно было написали, но тут все удобнее и более систематично упорядоченно!

СергейЦитировать

Спасибо! Я старался учесть, что об этом уже было не раз написано, поэтому перечитал самое лучшее, составил список вопросов которые лично у меня остались и сделал на них упор в своей статье.

Климович НиколайЦитировать

Супер! Отлично!

copsЦитировать

Спасибо!

Климович НиколайЦитировать

Просто потрясающий лонгрид! Спасибо!

IvanzaЦитировать

Спасибо, приятно!

Климович НиколайЦитировать